A Closer Look at Spatiotemporal Convolutions for Action Recognition[Tran+ CVPR18]

A Closer Look at Spatiotemporal Convolutions for Action Recognition[Tran+ CVPR18]の解説を行う.

まとめ

- 2DResNetがSports-1M(動画ベンチマークデータセット)において,SoTAに近い精度でAction Recognitionができる. でも,2DCNNってモーションのパターンや時間的情報をモデル化できないのに,えもいなあ. そもそも動画は,行動のクラス情報がシーケンス内で性的フレームの中にも含まれているので時間を使った推論っていらないんじゃね?ってなった.

- 上記の問題点を考えるために,3DCNNの役割について議論をする. でも,結構3DCNNについてはやられているので,residual learningをしているという縛りをつけて再考をする.

- 提案手法1. Mixed Convolution. ネットワークの最上層で2DCNN,その後の初期層で3DCNNを使うと,2DResNetより3~4%高い精度が出た. 加えて,3倍以上のパラメータを持つ3DResNetと同等の精度が出る.

- 提案手法2. R(2+1)D. 3DCNNを使うのではなく,2DCNN + 1DCNNを使う. 3DCNNと同じパラメータ数だが,非線形化するところが2倍になるので,複雑なモデルを学習できてえもくなる. 加えて,この分解がパラメータを最適化しやすいようにする. ResNetのConvを全部(2+1)Dにしたら,KineticsとSports-1MでSoTA.

- Factorized Spatio-Temporal Convolutionak Networks[Sun+ ICCV2015]に近い. networkをfactorizationしようとするが,R(2+1)Dはlayerでしている.

- Pseudo-3D network[Qiu+ ICCV2017]とも近い. 2DResNetをビデオに適用しており,3つの異なるResBlockを提案している.(その論文の図を見てください. 見ればわかります.)(A)空間から時間,(B)空間と時間の並列,(C)空間のskip-connection. これはネットワークの深さによってBlockが変わるが,R(1+2)Dはずっと均一.

手法

R2D

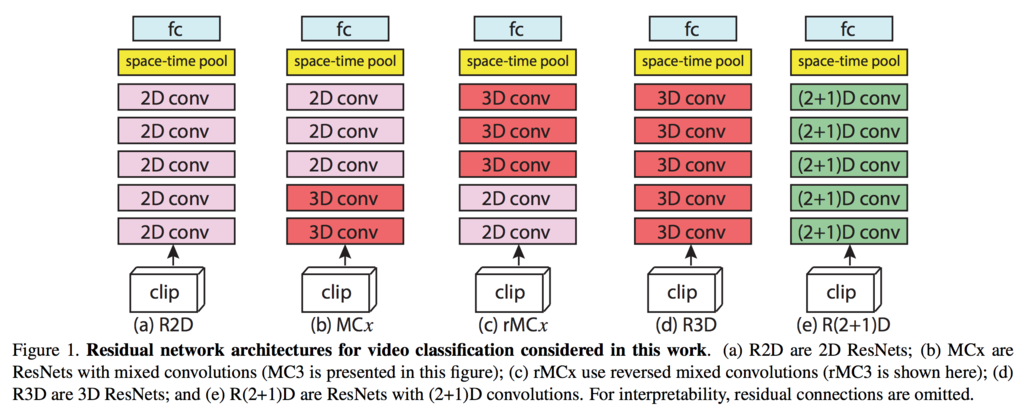

(a)R2D

入力x (3 x L x H x W)があって,2DCNNだと空間方向は関係ないので,x (3L x H x W)にリサイズして入力する.

Mixed Convolution

仮説として,モーションモデリング(3DCNN)は初期層で有用だが,抽象化された後期層ではモーションや時間的モデリングは必要ないことがある.

なので,最初3DCNN使うが,最後の方で2DCNNに変える. (b)では4,5を3DCNNに変えているので,MC4と呼ぶ.

また,対立仮説として,2DCNNを使って外観情報を先に取り込むことで,有益になるかもしれないので,上記と逆のこともする. これをreversed MC3は(c)になる.

R(2+1)D

3DCNNを2DCNN + 1DCNNで近似する(e). メリットは + パラメータ数同じだが,ReLUの数が2倍になるので非線形数2倍になる. 非線形を増やすと複数の小さなフィルタが大きなフィルタの効果と同じような役割になる(VGGのろんぶ〜んに書かれている.)

実験

- KineticsとSports-1Mをスクラッチからのモデル評価.

- 上記モデルをUCF101とHMDB51でfinetuningして評価.

spatio temporal convの比較

Kinetics validation datasetによる,ResNet18のCNNを変えた時の結果

Kinetics validation datasetでの縦軸: 精度,横軸: 計算コストの結果 青: R(1+2)D,赤: R2D,紫: R3D

青は精度ずば抜けて高くて,R3Dとほぼ同じ計算量である.

video lebelでの予測の比較

(a) クリップ数と精度,(b) top-1 accuracy.

34-layer R(2+1)D net

Sports-1Mでの結果

Kinetics

Finetuning

UCF101とHMDB51

Conclusion

- Action Recognitionにおける,異なるspatiotemporal convollutionsの効果を調べた.

- singleモデルのResNetに取り組んでSota出した.

感想

- two-branch networkで片方R(2+1)D,もう片方3DCNNで異なる意味を持つ特徴抽出とかやったらなんかわかりそう?

- 結局,Action Recognitionにおいては時間的特徴はあんまり関係ないのか?もし,例えばこれがフレーム予測生成などになると空間的特徴は必要だと思うので実験してみたい.

次読む論文

気になった人へ + Non-local Neural Networks[Xiaolong Wang, Ross Girshick, Abhinav Gupta, Kaiming He, CVPR18], https://arxiv.org/abs/1711.07971